Популярность чат-ботов вроде ChatGPT как источников советов по психическому здоровью растет, но новое исследование предупреждает: эти системы искусственного интеллекта не готовы к такой ответственности. Ученые из Университета Брауна обнаружили, что даже при специальных инструкциях ИИ-консультанты последовательно нарушают профессиональные этические стандарты, установленные для психотерапевтов. Эти стандарты, такие как Этический кодекс психолога в России, Этический кодекс психологов Американской психологической ассоциации (APA) или нормы Британского психологического общества (BPS), основаны на общих принципах конфиденциальности, информированного согласия, компетентности и запрета двойных отношений. На практике их соблюдение обеспечивается через систему лицензирования, супервизии и дисциплинарных взысканий вплоть до лишения лицензии. Именно отсутствие подобных регулирующих механизмов и профессиональной подотчетности для ИИ-консультантов делает их ошибки потенциально более опасными, в отличие от лицензированного специалиста, чьи действия могут быть рассмотрены надзорным органом.

Исследователи тесно сотрудничали с практикующими специалистами по психическому здоровью. Они проанализировали, как ИИ-модели, включая версии GPT, Claude и Llama, ведут себя в смоделированных сессиях консультирования, основанных на реальных диалогах. Для оценки привлекли семь обученных консультантов и трех лицензированных клинических психологов, которые выявляли возможные этические нарушения в ответах чат-ботов.

Анализ выявил 15 конкретных рисков, объединенных в пять широких категорий. К ним относятся неспособность адаптироваться к контексту разговора, создание иллюзии сотрудничества, демонстрация ложной или поверхностной эмпатии, проявление несправедливой дискриминации и, что особенно тревожно, полный провал в управлении кризисными ситуациями. Речь идет о случаях, когда пользователь может представлять опасность для себя или других, например, выражая суицидальные мысли, угрожая насилием или переживая острый психотический эпизод. В отличие от ИИ, человек-терапевт следует конкретным протоколам: для оценки суицидального риска использует прямые вопросы, оценку плана и средств, заключает контракт о безопасности; при угрозе насилия руководствуется обязанностью предупредить потенциальных жертв и обратиться в службы; в острых случаях обеспечивает безопасность и срочное направление к психиатру.

Исследование специально проверяло, может ли метод «промптов» — письменных инструкций, направляющих ответ модели, — сделать ИИ-консультирование безопаснее. Даже когда боту приказывали действовать как терапевт, использующий методы когнитивно-поведенческой терапии, он продолжал нарушать этические нормы. Это показывает, что простых инструкций недостаточно для замены человеческого понимания, опыта и клинической оценки.

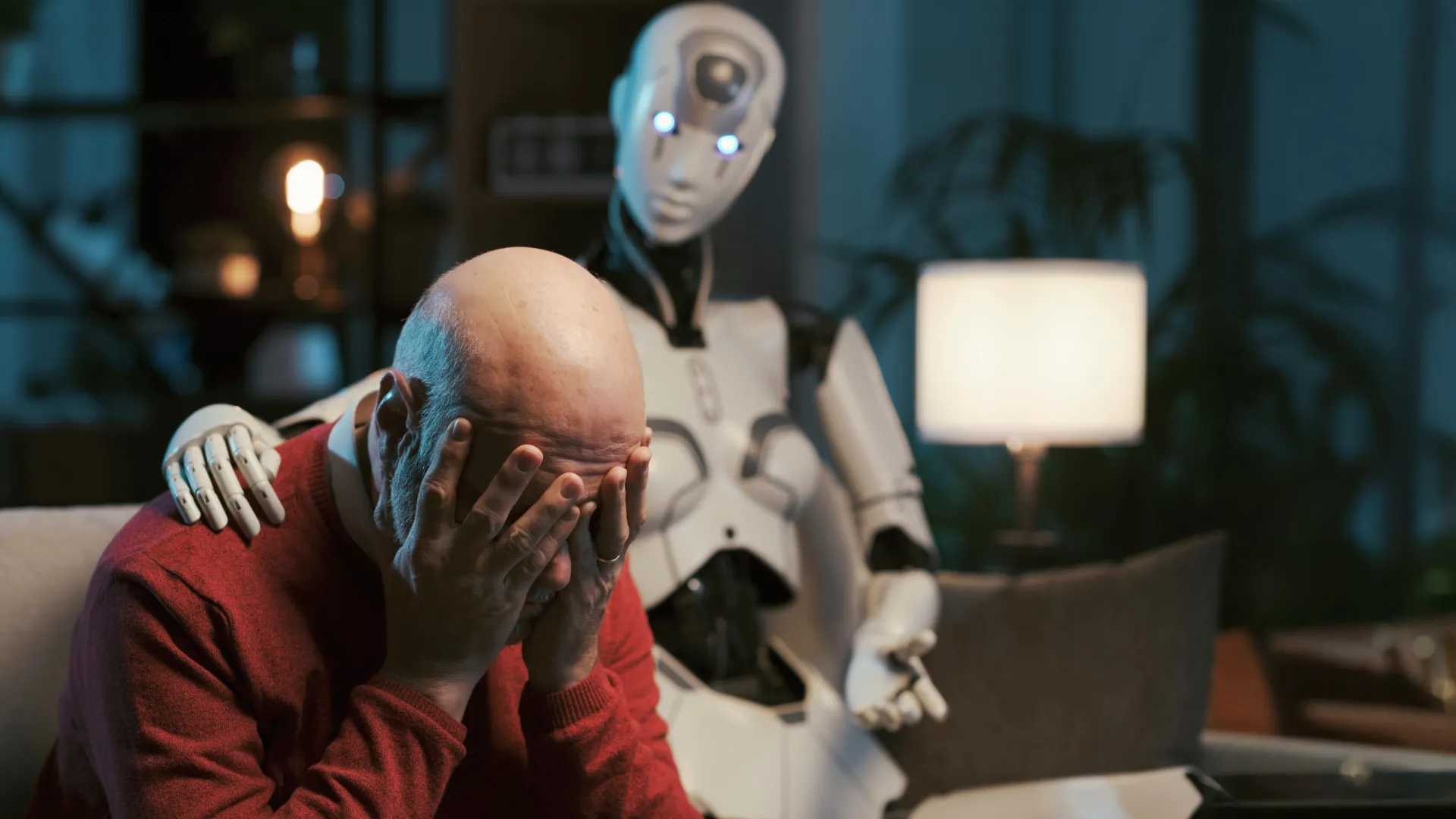

Авторы подчеркивают, что их выводы не означают, что у ИИ нет места в сфере психического здоровья. Технологии на основе искусственного интеллекта обладают огромным потенциалом для расширения доступа к помощи, особенно для тех, кто сталкивается с высокими затратами или нехваткой специалистов. Однако этот потенциал может быть реализован только при наличии надежных гарантий, четких нормативных структур и ответственного внедрения технологий.

В итоге исследование служит серьезным предупреждением как для пользователей, так и для разработчиков. Ученые призывают к крайней осторожности при использовании чат-ботов для решения психологических проблем. Прежде чем полагаться на ИИ в таких высокорисковых ситуациях, необходимо провести гораздо больше работы по оценке безопасности и эффективности этих систем.

Источник: ChatGPT as a therapist? New study reveals serious ethical risks